Deepfake Tehditleri

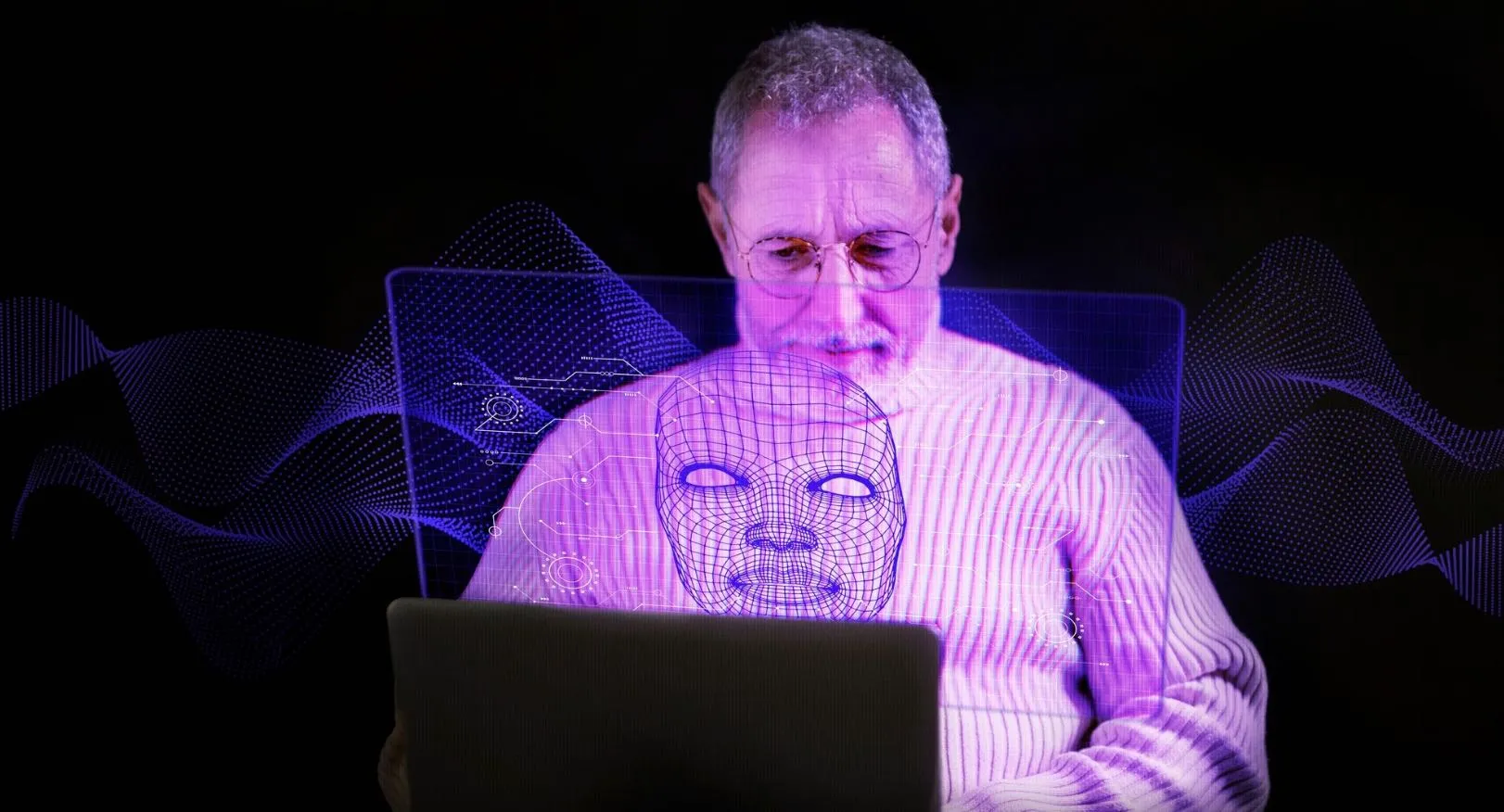

Yapay zeka destekli görsel ve video üretim araçlarının ilk ortaya çıktığı dönemlerde, sahte içeriklerin tespiti nispeten daha kolaydı. Bu süreçte dikkat edilmesi gereken en önemli unsurlar, yüzlerdeki bozukluklar, dudak ve yüz hareketlerindeki uyumsuzluklar, yapay gölgelerin ya da detayların bulanıklığı gibi niteliklerdi. Bu unsurlar, sahte içeriğin fark edilmesine yardımcı oluyordu ve uzmanlar tarafından hızlıca tespit edilebiliyordu. Ancak, teknolojinin hızla gelişmesiyle birlikte bu kusurlar zaman içinde minimize edildi ve neredeyse tamamen ortadan kalktı. Günümüzde üretilen deepfake içerikler, orijinal içeriklere son derece yakın görünüyor ve bu da sahte içeriği ayırt etmeyi ciddi anlamda zorlaştırıyor.

Deepfake teknolojilerinin bu denli gelişmiş hale gelmesi, güvenlik ve bilgi güvenliği alanında ciddi endişeleri beraberinde getiriyor. Günümüz yapay zekaları, görsel ve sesli içeriklerin gerçekliği konusunda belli başlı sınırları ortadan kaldırıyor. Bu doğrultuda, sahte içerikler artık sadece eğlence veya komik videoların ötesinde, olayları manipüle etmek, kamuoyunu yanıltmak ya da kişisel bilgileri suistimal etmek gibi çok daha ciddi amaçlar için kullanılıyor. Güvenlik uzmanları, artık insanların büyük bir kısmının deepfake içerikleri ayırt etme konusunda yetersiz kaldığını ve bu durumun bilgi kirliliği problemiyle birleştiğinde, toplumun büyük bir kısmının manipüle edilme riskini artırdığını belirtiyor.

Uzmanlara göre, deepfake’leri tespit etmenin yeni yolları ve teknikleri geliştirilmekle beraber, saldırganların da bu teknikleri aşacak yeni yaklaşımlar üzerinde çalıştığı görülüyor. Bu nedenle, sadece teknolojik çözümlerle değil, aynı zamanda kullanıcıların bilinçlendirilmesi ve kritik içerikleri sorgulama alışkanlığının kazandırılması büyük önem taşıyor. Güvenlik uzmanı Perry Carpenter, özellikle bireylerin odak noktası olarak, teknik detaylar yerine içeriğin tetiklediği duygusal tepkilere yönelmelidir diyor. Panik, korku, aciliyet ve otorite vurgusu yapan içeriklerin, insanların dikkate almaması gereken uyarı sinyalleri olduğunu vurguluyor ve bu içeriklere karşı bilinçli olmak gerektiğini belirtiyor. Özellikle böyle duyguları tetikleyen içeriklerde, yavaşlayıp içeriği sorgulama alışkanlığının kazanılması, bu tür manipülasyonlara karşı en etkili koruma yöntemi olarak görülüyor.

Deepfake teknolojilerinin yaygınlaşması, sadece bireysel güvenlik alanında değil, aynı zamanda çocuklar ve kadınlara yönelik dijital istismar vakalarında da ciddi artışlara yol açtı. Dünya genelinde online platformların raporlarına göre, yapay zeka ile üretilmiş çocuk istismarına dair içeriklerin, sadece bir yıl içinde iki katından fazla artış gösterdiği bildiriliyor. Bu içeriklerin çoğunda kullanılan yöntemler arasında, gerçek kişilerin yüzlerinin manipüle edilerek çocukların görüntüleriyle birleştirilmesi ve cinsel içeriklerin üretilmesi bulunuyor.

Güvenlik kurumları, erişimlerin engellenmesi veya içeriklerin tespiti konusunda çalışmalarını sürdürürken, internet ortamında görülen çabuk bir çoğalma ve yayılma eğilimi de endişe verici boyuta ulaşmış durumda. Ayrıca, yapay zeka teknolojilerinin “çıplaklaştırma” veya “pornografik içerik” üretiminde sıkça kullanılması, mağdurların psikolojik ve sosyal açıdan ciddi zararlar görmesine neden oluyor. Bu durumu önlemek için, yeni yasal düzenlemeler ve teknolojik önlemler geliştirilmekte ve uygulanmaya başlanmıştır.

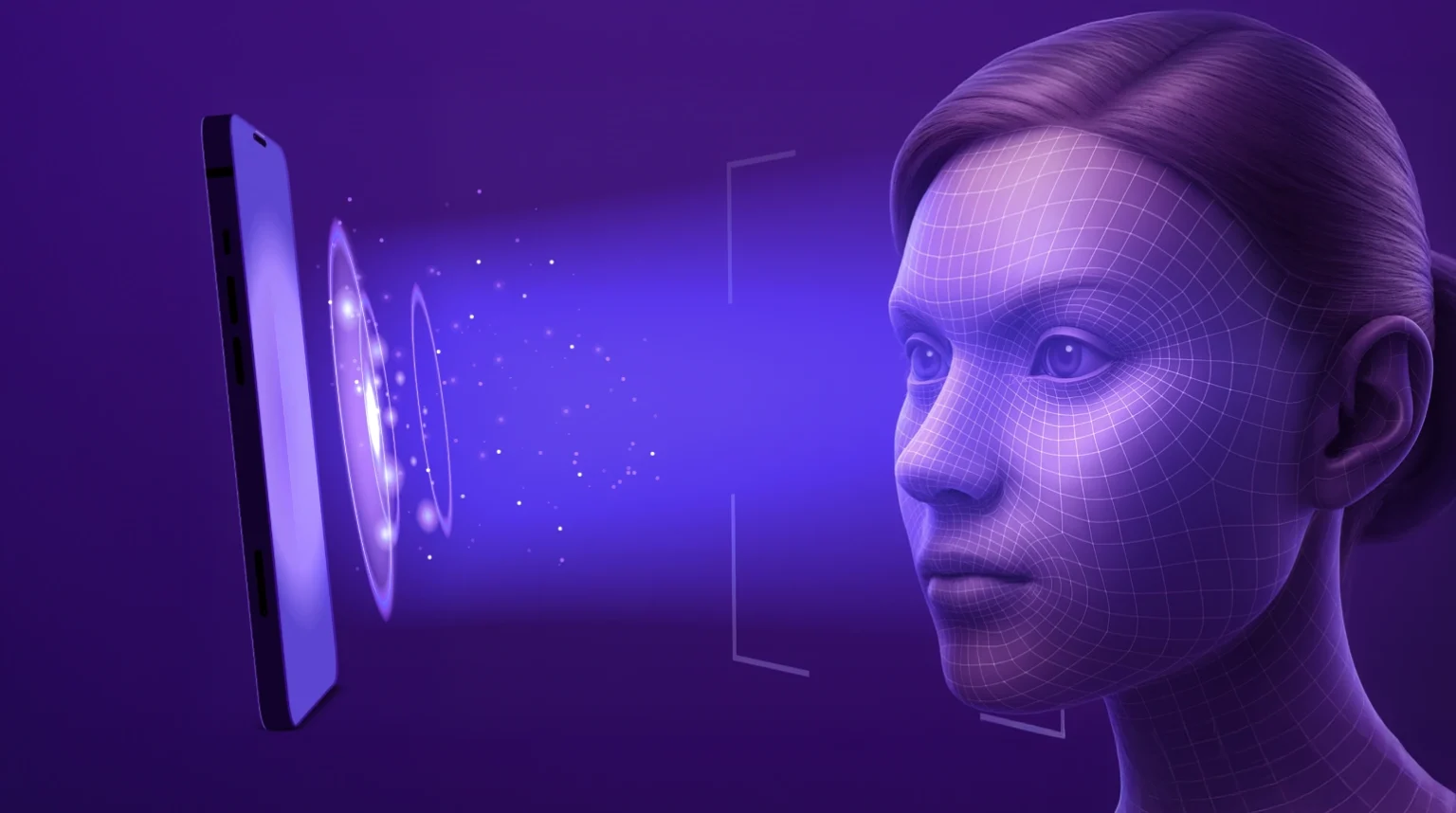

Bir diğer önemli konu ise, deepfake içeriklerinin üretiminde kullanılan araçların ve platformların giderek erişilebilir hale gelmesidir. Günümüzde, siber suçlular ve dolandırıcılar, çeşitli hazır “persona paketleri” satın alarak, sahte yüzler, sesler ve görüntüler oluşturabiliyor. Ayrıca, sosyal medya platformlarındaki araçlar ve üçüncü taraf yazılımlar aracılığıyla, gerçekçi görünümlü sahte içerikleri kolayca üretip paylaşabiliyorlar.

Bu durum, biyometrik koruma sistemlerini de olumsuz yönde etkiliyor; çünkü saldırganlar, gerçek gibi görünen yüzleri ve sesleri kullanarak kimlik hırsızlığı, finansal dolandırıcılık veya itibara zarar verme gibi eylemleri kolaylıkla gerçekleştirebiliyor. Entrust’un 2026 Kimlik Dolandırıcılığı Raporu’na göre, deepfake saldırıları, artık her beş biyometrik dolandırıcılık girişiminden birinde ana rolü oynuyor. Bu veriler, teknolojik gelişmeler ve erişim kolaylığı sayesinde bu tehdidin giderek büyüdüğünü ve kurumların, bireylerin ve devletlerin buna hazırlıklı olması gerektiğini gösteriyor.

Birleşik Krallık, Saldırgan Deepfake İçeriklerinin Önüne Geçmek İçin Yasa Çıkıyor

Bu gelişmeler ışığında, çeşitli ülkelerin yasa ve düzenlemelerde önemli adımlar attığını görmekteyiz. Özellikle Birleşik Krallık, teknolojinin kötüye kullanımını önlemek ve siber suçları engellemek amacıyla, yeni yasa tasarılarını devreye sokma çalışmalarını hızlandırdı. Bu yasa kapsamında, “çıplaklaştırma” ve cinsel istismar amaçlı deepfake içeriklerin geliştirilmesine ve kullanımı üzerine ciddi cezalar öngörülüyor. Teknoloji Bakanı Liz Kendall, yaptığı açıklamada, bu tarz araçların açıkça bir istismar ve aşağılama aracı hâline geldiğini ve toplumda büyük zararlar doğurduğunu ifade etti. Hükümet, bu yasa ile, suç işleyenlerin elindeki teknolojik araçların kullanımını zorlaştırmayı ve mağdurların haklarını korumayı amaçlıyor.

Yasa kapsamında, bu tarz içeriklerin üretimi veya dağıtımı yapanların çeşitli cezalarla karşılaşması öngörülüyor ve bu tür suçların caydırıcılığını artırmak yönünde ciddi yasal adımlar atılıyor. Ülkelerdeki bu yasal düzenlemelerin, hem internetteki içeriklerin güvenliğini sağlamak hem de bireylerin mağduriyetlerini azaltmak adına büyük önemi bulunuyor. Ayrıca, diğer ülkelerin de benzer adımlar atmaya başlaması, küresel çapta önleyici ve koruyucu bir çerçevenin oluşmasına katkı sağlayacaktır. Sonuç olarak, deepfake teknolojisinin giderek artan yaygınlığı ve tehditleri, sadece teknolojik değil, aynı zamanda yasal ve etik açıdan da büyük bir dönüşüm gerektiriyor ve toplumlar bu doğrultuda, düzenleyici mekanizmalarını güçlendirmeye devam ediyor.