Discord, yaş sınırlaması bulunan içeriklere erişim için kullanıcıların Mart ayı başından itibaren yaş doğrulaması yapması gerekeceğini açıkladı. Duyuruya göre doğrulama sürecinde iki yöntem öne çıkıyor: kimlik ile doğrulama veya yüz taraması ile doğrulama. Bununla birlikte en kritik detay, sistemin varsayılan yaklaşımı: Tüm hesaplar, kullanıcı “yetişkin” olarak doğrulanana kadar “çocuk deneyimi” olarak adlandırılan daha kısıtlı bir moda ayarlanacak.

Bu karar, Discord’un yıllardır uyguladığı NSFW (yaş sınırlı) kanal etiketleri, sunucu uyarıları ve içerik filtrelerinin ötesinde, daha merkezi ve daha zorunlu bir kimlik doğrulama çizgisine geçiş anlamına geliyor. Özellikle topluluk odaklı platformlarda bu tür adımlar, hem güvenlik hem de gizlilik tartışmalarını aynı anda gündeme taşıyor. İşte detaylar:

“Çocuk Deneyimi” Ne Demek ve Kullanıcıyı Nasıl Etkileyecek?

Discord’un “çocuk deneyimi” ifadesi, pratikte platformdaki bazı alanların ve içerik türlerinin otomatik olarak sınırlandırılması anlamına geliyor. Böyle bir modun tipik sonuçları şunlar olabilir:

- Yaş sınırlı kanalların ve sunucuların görünürlüğünün azalması veya tamamen kapanması.

- Hassas içerik uyarısı bulunan medya öğelerinin (görsel, video) otomatik filtrelenmesi.

- Bazı arama sonuçlarının, bağlantı önizlemelerinin veya sunucu keşif akışının daraltılması.

- Mesajlaşma ve etkileşim tarafında ek güvenlik katmanları. (örneğin daha katı spam ve DM filtreleri)

Discord, yetişkin doğrulaması tamamlanana kadar hesabı bu moda alarak, yaş doğrulama yapılmayan bir hesabın yanlışlıkla yetişkin içeriklerine erişmesini engellemeyi hedefliyor. Ancak bunun yan etkisi, yetişkin kullanıcıların da doğrulama yapana kadar daha sınırlı bir deneyimle karşılaşacak olması. Bu da özellikle platformu yoğun kullananlar için “isteğe bağlı” olmaktan çok “mecburi geçiş” hissi yaratabilir.

Yaş Doğrulaması Neden Şimdi Gündemde?

Discord gibi küresel platformların yaş doğrulamasına yönelmesinin arkasında genellikle üç ana baskı bulunur:

- Yasal düzenlemeler ve uyumluluk baskısı: Birçok ülkede çocukların çevrim içi güvenliği, yaş sınırlı içeriklerin kontrolü ve platform sorumluluğu konusunda düzenlemeler artıyor. Platformlar da yaş beyanına dayalı sistemlerin artık yeterli görülmediği bir döneme giriyor.

- Reklam, ödeme ve risk yönetimi: Yaş sınırlı içeriklerin yanlış kitleye ulaşması, platform açısından hem itibar hem de hukuki risk demek. Reklam ve ödeme altyapıları da giderek daha sıkı “yaş uygunluğu” talepleriyle çalışıyor.

- Güvenlik ve kötüye kullanım önleme: Yaş doğrulaması, çocukların yetişkin içeriklerine erişimini sınırlamanın yanında, bazı istismar türlerini azaltmak için de bir araç olarak görülüyor. Her sorunu çözmez, fakat denetim araçlarını güçlendirebilir

Bu adımın zamanlaması, genel olarak “platformların daha sert kimlik doğrulama uygulamalarına yöneldiği” küresel eğilimle uyumlu.

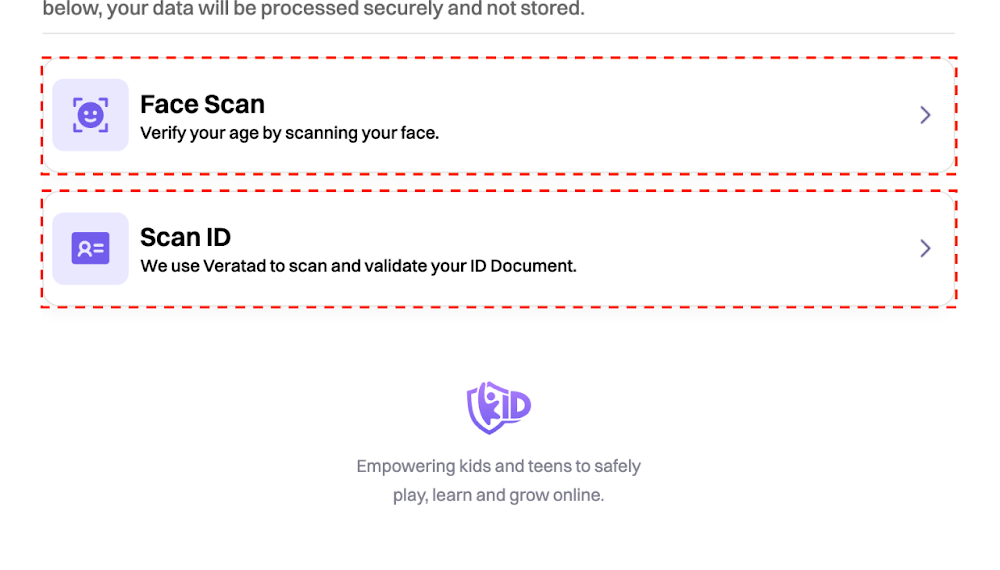

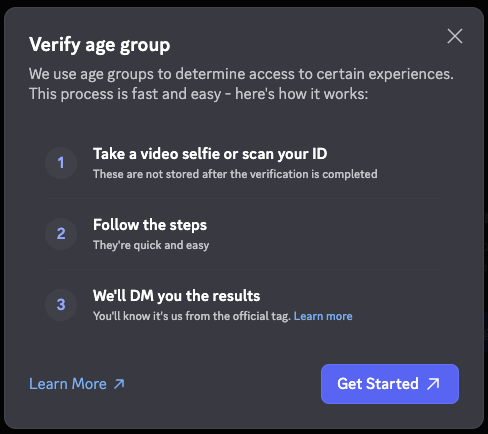

Kimlik ile Doğrulama Ve Yüz Taraması

Discord’un belirttiği iki doğrulama yöntemi, benzer hedefe hizmet etse de kullanıcı açısından farklı risk ve konfor alanları barındırır.

Kimlik ile doğrulama genellikle bir resmi belgenin (kimlik kartı, ehliyet, pasaport gibi) fotoğrafının yüklenmesi veya bir doğrulama sağlayıcısı üzerinden kontrol edilmesi anlamına gelir. Buradaki temel endişeler; belgenin hangi verilerinin işlendiği, ne kadar süre saklandığı ve sürecin üçüncü taraf bir şirket tarafından yürütülüp yürütülmediğidir.

Yüz taraması ile doğrulama ise çoğu zaman “yaş tahmini” veya “canlılık kontrolü” mantığıyla çalışır. Sistem, kameradan alınan görüntüyle kişinin yetişkin olup olmadığına dair bir tahmin üretir ya da kimlikteki kişi ile eşleştirme yapar. Bu yöntemin en hassas noktası, biyometrik verinin niteliğidir: Yüz verisi, sıradan bir e-posta adresi gibi kolayca değiştirilebilen bir bilgi değildir.

Kullanıcı açısından soru şudur: “Yetişkin olduğumu kanıtlamak için hangi veriyi vermek daha makul ve daha güvenli?” Bu sorunun tek bir doğru cevabı yok; kişinin yaşadığı ülke, gizlilik hassasiyeti, hesabı kullanma amacı ve teknik imkanları (kamera erişimi gibi) sonucu etkiler.

Gizlilik ve Veri Güvenliği Açısından En Büyük Soru İşaretleri

Yaş doğrulama denince tartışma kaçınılmaz olarak gizlilik tarafına gelir. Kullanıcıların en sık sorduğu başlıklar şunlardır:

- Doğrulama verileri Discord tarafından mı yoksa üçüncü taraf bir doğrulama şirketi tarafından mı işlenecek?

- Kimlik görüntüsü veya yüz taraması sonucu üretilen veriler ne kadar süre saklanacak?

- Veriler sadece “yetişkin/çocuk” sonucunu üretip silinecek mi, yoksa tekrar kullanılabilecek şekilde tutulacak mı?

- Olası bir veri ihlalinde kullanıcı nasıl korunacak?

Bu noktada şeffaflık kritik hale gelir. Discord’un, doğrulama akışında hangi verinin hangi amaçla işlendiğini, saklama süresini ve silme politikasını net biçimde açıklaması beklenir. Çünkü kullanıcı güveni, yalnızca güvenlik hedefiyle değil, bu hedefe giderken kullanılan yöntemlerin ölçülülüğüyle de doğrudan ilişkilidir.

Sunucu Sahipleri, Moderatörler ve İçerik Üreticileri İçin Ne Değişebilir?

Bu kararın etkisi yalnızca bireysel kullanıcıyla sınırlı değil. Sunucu yönetenler açısından yeni bir dönem başlatabilir:

- Yaş sınırlı kanalların erişimi daha fazla kontrol altına girebilir ve doğrulanmamış hesaplar için görünmez hale gelebilir.

- Moderasyon iş yükü bazı alanlarda azalabilir (yaş uygunsuz erişim denemeleri düşebilir), bazı alanlarda artabilir (doğrulama yüzünden gelen şikayet ve itirazlar).

- Topluluk büyümesi yavaşlayabilir; çünkü yeni kullanıcıların bir kısmı doğrulama sürecine girmek istemeyebilir. Bu özellikle yetişkin odaklı, ancak “tamamen NSFW” olmayan topluluklarda bile etki yaratabilir.

İçerik üreticileri ve topluluk yöneticileri için en mantıklı hazırlık, duyuruları netleştikçe sunucudaki kuralları ve bilgilendirme kanallarını güncellemek, kullanıcıların “neden bazı kanalları göremiyorum?” sorusuna önceden yanıt verecek bir rehber hazırlamak olacaktır.

Kullanıcılar Şimdiden Ne Yapmalı?

Mart başından itibaren uygulanacak bir değişiklik için kullanıcıların atabileceği pratik adımlar var:

- Discord’un resmi duyurularını ve yardım sayfalarını takip ederek doğrulama yöntemlerinin ayrıntılarını öğrenmek.

- Hesap güvenliğini güçlendirmek (iki aşamalı doğrulama, güçlü parola gibi), çünkü doğrulama süreçleri artınca hesap ele geçirme girişimleri de artabilir.

- Gizlilik tercihlerini gözden geçirmek ve mümkünse platform içindeki güvenlik ayarlarını güncellemek.

- Sunucu yönetenlerin, yaş sınırlı içerik etiketlemelerini ve kanal yapılarını gözden geçirmesi.

En önemlisi, doğrulama akışı ekrana düştüğünde aceleyle işlem yapmak yerine, hangi verinin istendiğini ve hangi seçeneklerin sunulduğunu dikkatle okumak.

Sonuç

Discord’un Mart başından itibaren kimlik veya yüz taramasıyla yaş doğrulaması istemesi ve tüm hesapları yetişkin doğrulanana kadar “çocuk deneyimi”ne alması, platformun yaş sınırlı içerik konusunu daha sert bir çerçeveye taşıdığını gösteriyor. Bu adım, çocukların korunması ve yaş uygunsuz içeriklere erişimin azaltılması açısından anlaşılabilir bir hedefe dayanıyor. Ancak kimlik ve biyometri gibi hassas verilerin devreye girmesi, kullanıcıların doğal olarak “veri nasıl işlenecek ve nasıl korunacak?” sorusunu sormasına yol açıyor.

Önümüzdeki dönemde en belirleyici unsur, Discord’un şeffaflığı olacak: doğrulama verisinin kapsamı, saklama süresi, üçüncü taraf kullanımı ve itiraz mekanizmaları netleştiği ölçüde tartışmanın tonu da şekillenecek.