Dijital dönüşüm hız kesmeden devam ederken, yapay zeka ve güvenlik açıkları konusu 2026’nın en sıcak başlıklarından biri haline geldi. Kurumların üretkenliği artırmak için entegre ettiği yapay zeka sistemleri, bir yandan iş süreçlerini optimize ederken diğer yandan veri gizliliği ve siber güvenlik açısından yeni risk alanları yaratıyor.

Son haftalarda yaşanan gelişmeler, özellikle kurumsal e-posta sistemleri, sağlık verileri ve araç içi yazılımlar üzerinden yapay zekâ tabanlı çözümlerin güvenlik sınırlarını yeniden tartışmaya açtı. Uzmanlara göre asıl sorun, teknolojinin kendisinden ziyade yapılandırma hataları, erişim kontrolleri ve veri sınıflandırma süreçlerindeki eksikliklerden kaynaklanıyor.

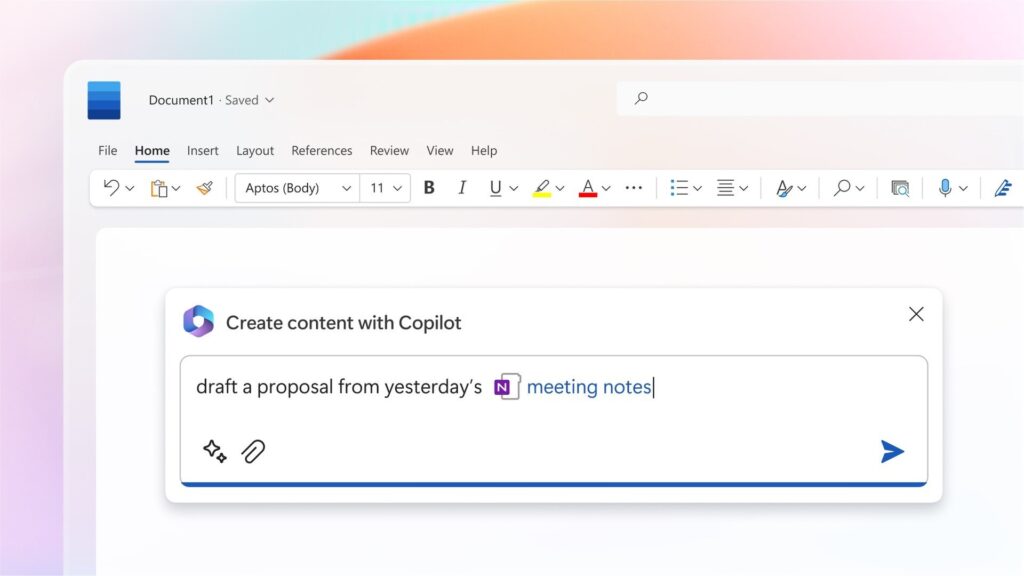

Microsoft 365 Copilot’ta Ortaya Çıkan Güvenlik Açığı

Microsoft tarafından geliştirilen Microsoft 365 Copilot, Word, Outlook ve Teams gibi araçlarda üretkenliği artırmak amacıyla kullanılıyor. Ancak BleepingComputer tarafından aktarılan rapora göre, sistemde tespit edilen bir güvenlik açığı, gizli olarak etiketlenmiş bazı içeriklerin yapay zeka tarafından işlenip özetlenmesine yol açtı.

Sorunun, özellikle Outlook’taki “Gönderilmiş Öğeler” ve “Taslaklar” klasörlerinde yer alan bazı hassas içeriklerin, gizlilik etiketlerine rağmen Copilot tarafından erişilebilir olmasıyla bağlantılı olduğu belirtildi. Bu durum, kurumsal yazışmaların istemeden analiz edilmesi ve özetlenmesi riskini doğurdu.

Microsoft, açığın tarihsel bir kod hatasından kaynaklandığını ve Şubat 2026 itibarıyla düzeltme güncellemesi yayımladığını açıkladı. Ancak şirket, kaç kullanıcının veya kurumun etkilendiğine dair net bir sayı paylaşmadı. Siber güvenlik uzmanları, bu tür olayların özellikle finans, hukuk ve sağlık gibi hassas sektörlerde ciddi sonuçlar doğurabileceğine dikkat çekiyor.

Bu gelişme, yapay zeka destekli üretkenlik araçlarının erişim yetkileri ve veri sınıflandırma politikalarıyla daha sıkı entegre edilmesi gerektiğini ortaya koyuyor.

Yapay Zeka, Sağlık Verileri ve Gizlilik Endişeleri

Google tarafından geliştirilen Google Gemini platformu, metinden içerik üretme ve multimedya oluşturma gibi özelliklerle genişlemeye devam ediyor. Yeni müzik üretim ve kişiselleştirilmiş içerik oluşturma araçları, eğlence tarafında ilgi görse de, hassas verilerin işlendiği sektörlerde dikkatli kullanım gerektiriyor.

Özellikle Birleşik Krallık’taki NHS gibi sağlık kurumları, hasta verilerinin korunması konusunda sıkı düzenlemelere tabi. Yapay zekâ araçlarının yanlış yapılandırılması ya da üçüncü taraf entegrasyonları, hasta bilgileri gibi kritik verilerin sızma riskini artırabilir.

Uzmanlar, sağlık sektöründe yapay zekâ kullanımında şu üç noktaya dikkat çekiyor:

- Veri anonimleştirme süreçlerinin eksiksiz uygulanması

- Bulut tabanlı sistemlerde şifreleme standartlarının güncel tutulması

- Yapay zekâ modellerinin eğitim verilerinin şeffaf biçimde denetlenmesi

Aksi halde, küçük bir yapılandırma hatası dahi geniş çaplı gizlilik ihlallerine yol açabiliyor.

Apple CarPlay ve Araç İçi Yapay Zeka Riskleri

Apple, iOS 26.4 güncellemesiyle birlikte Apple CarPlay sistemine daha gelişmiş yapay zeka entegrasyonları getirmeye hazırlanıyor. Navigasyon, mesajlaşma ve medya kontrolü gibi alanlarda daha akıllı öneriler sunacak bu sistem, kullanıcı deneyimini ileri taşıma potansiyeline sahip.

Ancak araç içi sistemlerde yapay zekâ kullanımı, yeni güvenlik katmanlarını da zorunlu kılıyor. Chat tabanlı asistanlar ve sesli komut sistemleri, konum verisi, iletişim geçmişi ve kişisel tercihler gibi hassas bilgileri işliyor. Bu verilerin üçüncü taraf uygulamalarla paylaşımı veya zayıf API güvenliği, potansiyel bir siber saldırı yüzeyi oluşturabilir.

Otomotiv siber güvenliği uzmanları, araç içi sistemlerde şu önlemlerin kritik olduğunu vurguluyor:

- Uçtan uca veri şifreleme

- Yetkisiz uygulama erişimlerinin sınırlandırılması

- Yazılım güncellemelerinin düzenli ve otomatik yapılması

Araçların giderek daha fazla “bağlı cihaz” haline gelmesi, otomotiv sektörünü de siber güvenlik zincirinin bir parçası haline getiriyor.

Yatırım, Regülasyon ve Kurumsal Sorumluluk

Yapay zeka ve güvenlik açıkları konusundaki artış, regülasyon tarafında da hareketliliğe neden oldu. Avrupa Birliği’nin AI Act düzenlemeleri ve ABD’deki veri koruma tartışmaları, şirketleri daha şeffaf ve denetlenebilir sistemler geliştirmeye zorluyor.

Kurumlar açısından en kritik konu, yapay zekâ çözümlerini entegre ederken güvenlik mimarisini baştan tasarlamak. Uzmanlara göre yalnızca yazılım güncellemesi yapmak yeterli değil; erişim politikalarının yeniden yapılandırılması, çalışan eğitimlerinin artırılması ve sürekli sızma testleri uygulanması gerekiyor.

Sonuç olarak 2026 itibarıyla yapay zeka ve güvenlik açıkları, teknoloji dünyasının en hassas kesişim noktasında yer alıyor. Üretkenlik ve inovasyon potansiyeli yüksek olan bu sistemler, doğru yapılandırılmadığında ciddi veri sızıntılarına yol açabiliyor. Kurumların ve bireylerin, yeni teknolojileri kullanırken güvenlik bilincini en üst seviyede tutması, dijital dönüşümün sürdürülebilirliği açısından hayati önem taşıyor.